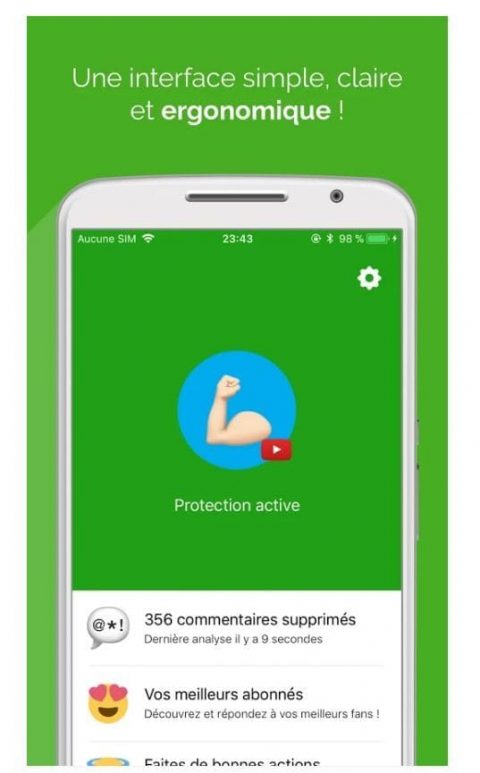

Créée par Charles Cohen, un développeur français de 22 ans, l’application Bodyguard protège ses utilisateurs des commentaires haineux publiés sur YouTube et Twitter, y compris pendant les lives.

Créée par Charles Cohen, un développeur français de 22 ans, l’application Bodyguard protège ses utilisateurs des commentaires haineux publiés sur YouTube et Twitter, y compris pendant les lives.

Le fonctionnement de son algorithme semble bien plus efficace que les filtres proposés par les réseaux sociaux et qui nécessitent un paramétrage extrêmement minutieux et exhaustif de la part de l’utilisateur.

Internet est devenu un lieu d’échanges où tout le monde veut s’exprimer et où l’insulte est facile, virant trop souvent au harcèlement. Ainsi est né le projet Bodyguard : « en deux millisecondes » l’appli est capable d’identifier les insultes adressées à un utilisateur, avec une marge d’erreur de 2%.

Les commentaires supprimés avec l’approbation des utilisateurs de l’application ne contenaient fin 2017 que 1,5% de faux-positifs, une faible marge d’erreur inégalée par les outils similaires selon Charles Cohen.

Une modération intelligente, qui n’est pas basée sur l’IA

D’abord, Charles Cohen a défini une liste d’insultes francophones déclinées dans des milliers de propositions et a appris 60 millions de mots-clés à son logiciel. Mais son programme s’intéresse aussi aux mots qui précèdent et suivent l’insulte, afin d’en déterminer l’intention et de préserver la liberté d’expression des internautes bienveillants qui utiliseraient par exemple des tournures de phrases grossières telles que « les haters sont des connards » ou « ta vidéo, c dla merde. Non jrigole ».

Bodyguard se veut plus efficace que la modération des réseaux sociaux. Si beaucoup d’intelligences artificielles utilisées pour modérer apprennent des bases de données, elles ne sont pas pour autant capables de comprendre les subtilités du langage humain. Charles Cohen a passé six mois à entraîner son programme et continue à lui apprendre chaque jour avec de nouveaux commentaires. «Je ne voulais pas supprimer automatiquement les insultes, mais plutôt permettre à mon programme de les comprendre en contexte», ainsi Bodyguard prend en compte les relations entre les internautes : par exemple, des insultes échangées entre amis pourront être considérées comme des plaisanteries. Et pour être vraiment efficace, le programme comprend le langage SMS, les fautes, les émojis…

Le programme s’attache aussi au profil de l’utilisateur. Par exemple, si la personne qui l’utilise est une femme, il sera plus vigilant face aux remarques misogynes en reconnaissant les types d’insultes les plus prononcées. Il en va de même pour les injures homophobes, racistes, antisémites… Le tout avec l’intervention possible de l’utilisateur, qui peut indiquer vouloir bloquer par défaut les trolls, les menaces, les injures physiques…

Alors que Google et les réseaux sociaux sont régulièrement épinglés pour laxisme dans leur modération, Bodyguard permet à des Youtubeurs de se protéger gratuitement et ce, sans publicités.

Installez Bodyguard sur Android

Pour aller plus loin: